AI 创作的时代:它会取代音乐人,还是成为最强助手?

AI 创作的时代:它会取代音乐人,还是成为最强助手?

摘要 (TL;DR)

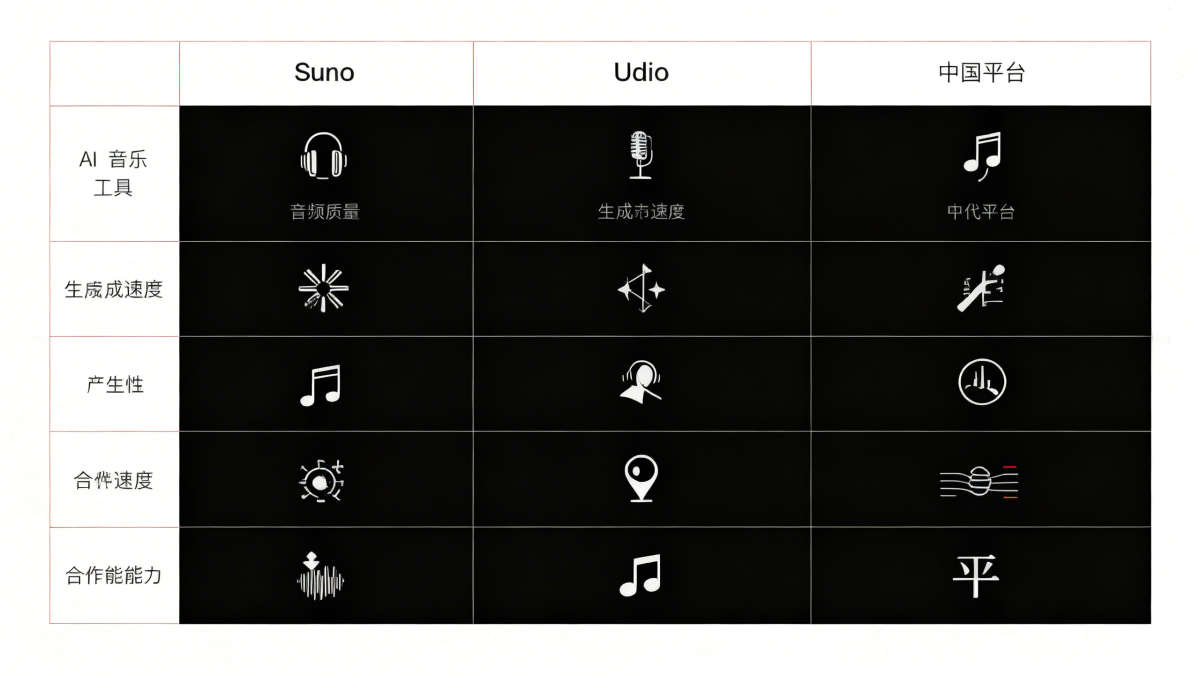

AI 音乐工具(如 Suno、Udio)的进化速度令人惊叹,不仅能生成高质量的 Demo,甚至开始具备细致的控制力。面对这一变革,音乐人的焦虑是真实的。本文深入探讨了 AI 目前的能力边界,指出 AI 虽能完成技术性的“快餐”制作,但缺乏人类独有的情感深度、审美判断和文化理解。文章提出,未来的音乐人应将自己定义为“创意决策者”,利用 AI 作为强大的辅助工具,通过人机协作(如 AI 做草稿、人类做决策)来提升效率与创意,从而在 AI 时代找到不可替代的价值。

上周去朋友工作室,看到他电脑上打开着Suno。输入一段描述,不到15秒,一首带着人声、贝斯和鼓点的完整Demo就出来了。他说这是给客户看的方案,以前要花2-3天,现在半小时能做5个风格的选项。

看到这场景,我一时有些复杂的情绪。作为一个做了几年音乐制作的人,我知道这意味着什么——效率提升是好事,但真正让人焦虑的,是那个一直在脑海里打转的问题:如果只是做商业配乐或者Demo这种“功能性音乐”,我还有多少价值?

这种焦虑并不是个例。这半年来,在各种社区上,“AI音乐”相关的话题几乎每天都在刺激着音乐人的神经。有人说这是“音乐民主化”,人人都能做音乐了;也有人说这是“艺术的终结”,难道输入几个关键词就算创作?

我想,比起争论,更重要的是看清AI到底能做什么、做不到什么,以及我们这些真实的音乐人,该如何在这个新时代找到自己的位置。

AI到底能做什么?

过去一年,AI音乐工具的进化速度远超很多人的预期。

生成质量的跃升

以Suno为例,2025年9月发布的v5版本基本消除了以前那种明显的“机械感”。人声开始有呼吸声、颤音,甚至根据曲风调整情绪表达。Udio v4更是做到了48kHz/24bit的录音棚级输出,乐器分离度明显提升,不再是以前那种“糊成一团”的感觉。

国内的网易云、腾讯音乐也都推出了自己的AI创作平台。特别是网易的XStudio,已经有十几款高度拟人的AI歌手音库,与版权系统打通后,普通用户也能快速生成一首完整的歌。

功能从“魔法按钮”到“创作工具”

AI工具不再只是“输入描述,等结果”。Suno现在支持Mashups(融合两首歌的风格)、Personas(保存特定人声角色跨曲目使用),甚至能单独生成Drum Loop或一段钢琴Riff。Udio的Magic Edit更是让你能精确地选中5秒钟的某一句歌词,单独重生成这一段而不影响其他部分。

这些功能意味着,AI开始从“一键生成器”变成了“可细致控制的生产工具”。你可以把AI生成的人声、贝斯、鼓分轨导出,再在DAW里进行二次编排和混音。

实际应用场景

在社区讨论中,专业音乐人总结出了一个“70%规则”:AI能在几分钟内完成70%的工作,但剩下30%仍然需要人类的判断和打磨。

一位知乎上的资深制作人分享,他现在用AI快速生成多版本的编曲参考,然后选一个最有感觉的,再用真实乐器或高端音源重新录制。原本需要2-3天的初期构思阶段,现在缩短到半天。

对于内容创作者来说,AI解决了配乐的大问题。微博上“西游系列”AI组曲频频出圈,普通网友几分钟就能做出一首完整的中国风歌曲。这在以前是不可想象的。

但AI做不到的,才是关键

看到这里,你可能会问:既然AI已经这么强大,音乐人真的还有存在的必要吗?

我的答案是:有。且比以往任何时候都更有。

“灵魂”不是玄学,是真实缺失

在Reddit和知乎的讨论中,专业音乐人的一个高频评价是:AI作品是“赛博快餐”。这不是贬低,而是一种准确的描述。

AI生成的音乐往往能“撑拨一群人的心动”,但缺少“创作者个体心碎的真实情感”。比如,你让AI做一首关于失恋的歌,AI能把所有“失恋歌曲”的典型特征做得很好——忍住眼泪、深夜独自、回忆画面。但它没有真的失恋过,也就没有那种只属于你自己的、无法复制的细节和呼吸。

一位独立音乐人在行业年会上说:“AI能做出技法上没问题的作品,但音乐的价值不在于没问题,在于那些“意外”和“不完美”。”比如Kurt Cobain的沙哑嘰音,比如周杰伦的咕噜唱腔,这些不符合“优美”标准的东西,恰恰是他们的标签。

审美判断和文化背景

AI可以模仿风格,但它不知道“为什么这样做是对的”。

一位制作人分享了一个案例:他给客户做一首新中式婚礼配乐,AI生成的版本技术上没毛病,但总觉得“差点意思”。后来他意识到,AI把中国风的元素堆叠得太满,反而显得廉价。真正的新中式需要“留白”,需要知道什么时候“不加”比“加”更高级。这种对文化的理解和审美判断,目前AI还做不到。

真实世界的复杂性

AI的训练数据来自已有作品,它的逻辑是“统计规律”。但音乐创作往往需要突破规律。

比如一个很具体的场景:为一部悬疑片配乐,导演希望在某个场景用“不协和的小提琴音”来营造不安,但后半段又要转到温暖的回忆。这种根据具体剧情、视觉画面、甚至是演员表情的微妙调整,需要制作人与导演的多轮沟通,AI无法参与这种复杂的协作。

版权与商业问题

还有一个现实问题:纯AI生成的作品目前不具备版权。根据2026年初的最新规定,只有“人机共创”且有人类实质性表达的作品才能获得保护。这意味着,如果你想用AI作品做商业化,仍然需要音乐人的介入。

最佳搭档:人机协作的实际路径

那么,如何找AI的正确打开方式?在过去半年的实践中,一些有效的协作模式已经形成。

模式1:AI做草稿,人类做决策

这是目前最常见的用法。用AI快速生成20-30个不同风格的版本,然后用你的审美经验挑选、融合、修改。比如你喜欢A版本的前奏,但更喜欢B版本的副歌部分,就可以把它们拼起来,再进行细节打磨。

一位制作人说:“以前我做一首歌的前期构思,可能要在脑子里试十几种方向。现在我让AI把这十几种方向都做出来,我听完再决定。这就像Sketch阶段有了一个很快的助手。”

模式2:AI生成素材,人类组装

用AI生成单独的元素——Drum Loop、贝斯线、人声样本、和弦片段,然后像搭积木一样自己组合。

在DAW中,你可以把AI生成的元素当成Sample库来用。比如你需要一段Trap风格的8-bar鼓点,以前AI可能需要花钱买Sample Pack或者自己编程,现在用Suno的Samples功能,30秒就能生成20个不同的选项。

模式3:AI做风格参考,人类重制

当你想尝试一种不熟悉的风格,可以先用AI生成一版“参考带”,听清楚大致的编排思路、乐器配置、节奏感,然后用真实乐器或高质量音源重新录制。

一位独立音乐人分享:“我之前没做Afrobeat,对这种风格的鼓点Pattern和贝斯走向不够敏感。我让Udio生成了10首Afrobeat风格的参考,听了几天找到感觉,再自己用真鼓和贝斯做。AI就像是给了我一个“速成启蒙课”。”

模式4:人类定框架,AI填细节

你先用DAW搭好主要的旋律、和弦走向、段落结构,然后用AI填充那些耗时但不决定核心表达的部分——比如鼓点、打击乐、环境音效。

这种方式特别适合商业项目。你掌握核心创意,AI帮你处理那些重复性劳动,既保证了作品的原创性,又大幅提升效率。

音乐人的未来:什么才是不可替代的?

写到这里,我想回到文章开头的那个问题:AI是会取代音乐人,还是成为最强助手?

我的答案是:这取决于你把自己定义成什么。

如果你把自己定义成“技术执行者”

如果你的价值只是“把客户的需求准确执行”,那确实会感到很大压力。因为AI在这方面正在迅速赶上。特别是那种“给个参考,照着做一首类似的”项目,AI已经能做得很好。

这就是为什么底层音乐制作人的报价在2025年后“腰斩”。但这不是行业的终结,而是职业分层的开始。

如果你把自己定义成“创意决策者”

那么你的核心竞争力在于:审美判断、情感表达、文化理解、以及对具体场景的把握。这些是AI目前做不到的。

未来的顶级音乐人,不一定是技术最好的,但一定是最懂“为什么这样做”的人。他们会用AI作为工具,但最终的创意主导权仍然掌握在自己手中。

现在就是转型的窗口期

2026年的行业共识是:AI不会消灭音乐行业,但会彻底洗牌。现在正是那个窗口期——那些愿意学习、尝试、找到人机平衡的人,会获得巨大的竞争优势。

关于如何应对,我的建议是:花一个月深度体验Suno、Udio或国内平台,找到适合自己工作流的用法;深化对某个风格的理解,提升审美判断和沟通能力;明确你作品中哪些是“人的表达”——不要让AI生成整首歌就直接用,至少要有你的决策、你的修改、你的烙印在里面。

最后的话

音乐的本质从来不是“做出一首歌”,而是“表达一个人”。AI可以做出技术上完美的声音,但它没有人生经历,也没有情感需求。这就是为什么无论技术如何进步,那些真正想说些什么的人,仍然不可替代。

AI时代,音乐人不会被淘汰。但那些不愿意思考“我的不可替代性在哪里”的音乐人,可能会。

🎧 准备好回归纯粹的音乐体验了吗?

让 iPlayer 成为你 Flac 无损收藏的家,开启属于你的高保真听觉之旅。

- 🔊 独占模式,追求极致音质

- 📂 强大的文件夹管理功能

- ✨ 纯净界面,回归听歌初心